Изкуственият интелект (AI) се развива динамично и е бъдещето на медицината. Въпреки това все още липсват разпоредби на международно ниво - особено правна дефиниция - дефиниращи изкуствения интелект и следователно яснота по въпроса за отговорността за възможни медицински грешки, възникващи при използване на оборудване, подпомагано от AI.

Потенциалът на ИИ в медицината

Диагностичните инструменти, поддържани от изкуствен интелект, повишават качеството и ефективността на здравеопазването. Те се използват предимно при интервюиране на пациент, анализиране на резултатите от теста, проследяване на състоянието на лекуваното лице и извършване на много други дейности от лекар с цел поставяне на подходяща диагноза. Правилното им функциониране зависи главно от голямо количество разнообразна информация, включително конкретни данни за пациентите.

- Неконтролираният достъп до такава информация може да доведе до увреждане на личния интерес на индивида. Центровете, предлагащи частни здравни грижи, които не искат да споделят своите информационни ресурси за пациенти - Конрад Ягоча, сътрудник, Kancelaria Prawna Chałas i Wspólnicy, са скептични относно натрупването на данни.

Няколко AI системи вече се използват в медицината. Един от тях е DXplain - програма, която след анализ на набора от симптоми, наблюдавани при пациент, представя списък с възможни диагнози. Окончателният избор обаче оставя на лекаря. Germwatcher също си струва да се обърне внимание. Това е лабораторна информационна система, която открива, проследява и изследва възможността за инфекции при хоспитализирани хора.

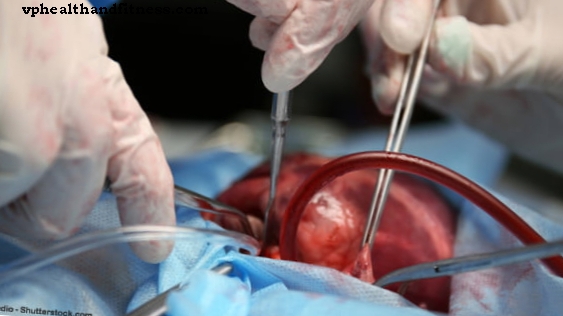

Въвеждането на роботизирани хирургични системи определено беше пробив. Използвайки системата DaVinci с роботизирани ръце, прецизно движение и магнитно зрение, клиницистите могат да извършват операции, които не биха били възможни при стандартни процедури.

Необходимост от регулация

Европейският парламент, заедно с Европейския икономически и социален комитет, посочват, че е необходимо да се изработи точно определение за изкуствен интелект. Той трябва да отговаря на изискванията за висока строгост и по този начин да не въвежда допълнителни неясноти, съмнения или празни вратички и да бъде достатъчно технологично „отворен“, за да не възпрепятства потенциалното развитие на AI технологията в бъдеще.

Определението за правен AI би ни позволило да идентифицираме кой е отговорен за всякакви медицински грешки, възникнали при използване на машини, подпомагани от AI.

- Следвайки разпоредбите на гражданското право, за да може да се прехвърли отговорност на даден субект, трябва да има, inter alia, едно от помещенията, адекватна причинно-следствена връзка между неговото действие или бездействие и събитието, в резултат на което е настъпила вредата. Изглежда много трудно да се възложи гражданска отговорност на субект за дейност, произтичаща от изкуствен интелект. Лекарят не може да предвиди намеренията на автономния индивид. Това е проблем, който се забелязва особено от противниците на използването на ИИ в медицината - Конрад Ягоча, сътрудник, Kancelaria Prawna Chałas i Wspólnicy.

Също така си струва да се отбележи, че разработването на диагнози от машини с ресурси с изкуствен интелект е статистически по-ефективно и по-бързо, отколкото от лекарите. Експертите обаче подчертават, че ИИ в медицината трябва да бъде под непрекъснат човешки надзор поради важността на ефектите, които всяко нарушение може да има. Това е духът например на Американската администрация по храните и лекарствата (FDA), която позволява на лекарите да провеждат само проучвания с AI с нисък риск.